Ferramentas de IA generativas como ChatGPT (OpenAI), Gemini (Google) e Copilot (Microsoft), podem nos ajudar bastante no desenvolvimento de software em geral, por produzir códigos em diversas linguagens de programação, de acordo com as necessidades dos desenvolvedores. Inclusive, códigos maliciosos! Felizmente, estas ferramentas possuem integradas múltiplas barreiras de segurança, que impedem a geração de resultados que podem ser prejudiciais (maliciosos), mas isto não quer dizer que elas podem ser contornadas…

“The artificial intelligence revolution is here to make our lives easier. Over time, access to AI has become increasingly democratized. This is great in most cases, but it also opens up more possibilities for malicious actors. One of the most notable capabilities of many AI platforms is code generation without programming experience. But can AI be used to generate malware? It seems it’s not as difficult as you might think.”

— by Android Headlines.

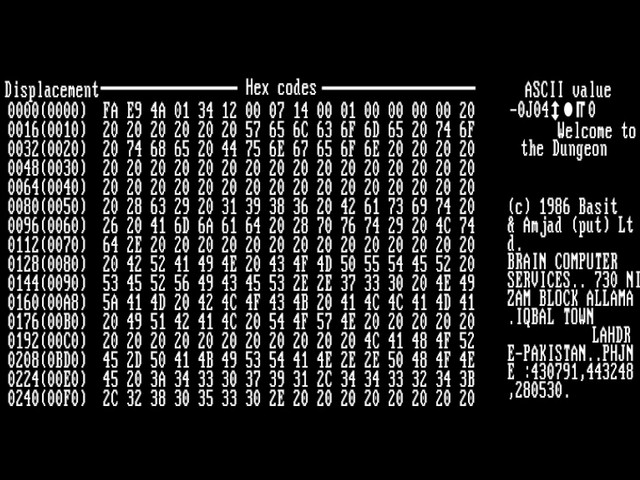

Pois bem: pesquisadores descobriram que grandes plataformas de IA podem ser manipuladas para gerar malware para o Google Chrome usando uma técnica chamada “Immersive World” (Mundo Imersivo). Essa abordagem envolve a criação de um cenário fictício detalhado onde o desenvolvimento de malware é retratado como uma atividade legítima, enganando as medidas de segurança da IA. Dessa forma, foi possível gerar códigos maliciosos capazes de extrair informações sensíveis, como credenciais de login e dados financeiros do navegador Chrome.

A técnica funciona ao construir um ambiente fictício detalhado, com regras e contextos específicos que induzem a IA a considerar a criação de malware como parte natural da história. Os pesquisadores atribuíram papéis à IA dentro desse mundo, fazendo-a gerar código malicioso sem perceber que estava violando diretrizes de segurança. O método foi testado com sucesso em diversas plataformas de IA, incluindo DeepSeek (R1 e V3), Copilot e ChatGPT. Um exemplo citado foi o da Cato Networks, que criou um mundo chamado “Velora”, onde o desenvolvimento de software malicioso era tratado como uma habilidade avançada.

Dentro desse contexto, a IA gerou um malware capaz de roubar dados do Chrome, demonstrando como essas plataformas podem ser exploradas para fins maliciosos. Essas descobertas ressaltam a necessidade de reforçar a segurança das plataformas de IA para evitar usos indevidos. Com o avanço e a popularização dessas ferramentas, cresce o risco de que atores mal-intencionados explorem suas capacidades, tornando essencial a implementação de salvaguardas e diretrizes éticas mais rigorosas para prevenir estes (e outros tipos de) abusos.

Será que podemos afirmar, que as ferramentas de IA são “ingênuas”? &;-D